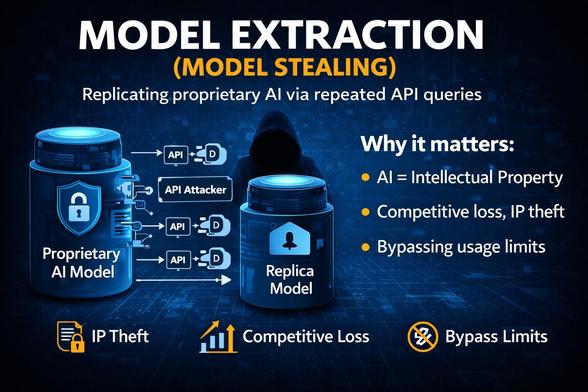

MODEL EXTRACTION: The AI Heist Nobody's Talking About

https://youtu.be/a6WtBx8l5Xk #CyberSecurity #AISecuity #MachineLearning #ModelStealing #ArtificialIntelligence #IPProtection #InfoSec #AIRisk #TechLeadership #DataProtection #ModelExtraction #CyberThreats #ResponsibleAI

#modelextraction

merve (@mervenoyann)

트윗은 'distillation-attack-as-a-service'를 언급합니다. 이는 모델 증류 기법을 악용해 모델 지식이나 동작을 모방·추출하는 공격을 서비스 형태로 제공한다는 의미로 해석될 수 있으며, 모델 저작권 침해·데이터 유출·보안 취약성을 시사합니다. AI 개발자와 보안팀은 API 사용·모델 공개 정책 및 추론 보안 방어를 점검해야 합니다.

https://x.com/mervenoyann/status/2030017555830546762

#modelextraction #distillationattack #aisecurity #adversarialml

[Anthropic, 중국 AI 기업들의 Claude 불법 증류 공격 탐지 및 대응 공개

Anthropic은 중국 AI 기업 DeepSeek, MiniMax, Moonshot AI가 Claude 모델을 불법으로 증류하려 했다고 공개했습니다. 이들은 24,000개의 허위 계정을 생성해 1,600만 건 이상의 대화를 생성했으며, Anthropic은 행동 기반 탐지와 체인-오브-쏘트 추출 패턴 탐지 등을 통해 대응했습니다. 이 사건은 국가 안보 위협으로 규정되며, 업계와 정책 입안자들의 공동 대응이 필요하다고 강조했습니다.

https://news.hada.io/topic?id=26948

#aisecurity #modelextraction #anthropic #claudemodel #nationalsecurity

Client Info

Server: https://mastodon.social

Version: 2025.07

Repository: https://github.com/cyevgeniy/lmst